Fumata blanca en Bruselas después de más de 22 horas de reunión para acordar una regulación de la inteligencia artificial (IA). Después de una sesión maratoniana, la Unión Europea (UE) ha llegado a un primer acuerdo sobre la ley de IA, donde se regularán los modelos fundacionales en que se basan sistemas como ChatGPT. Sin embargo, fuentes europeas apuntan a EFE que aún quedan "muchas cosas" por cerrar, que se continuarán debatiendo este viernes a partir de las 9 horas, cuando se retomarán las negociaciones. Uno de los temas más disputados es el límite del uso de la IA para la vigilancia biométrica.

El Consejo de la UE, el Parlamento Europeo y la Comisión Europea se encerraron el miércoles a las 15 horas y hasta las 13 horas de este jueves no han parado de negociar lo que será la ley de IA de la Unión. Se trata de una negociación muy compleja, en un terreno todavía desconocido, pero muy demandada por la explosión que ha sufrido el último año esta tecnología.

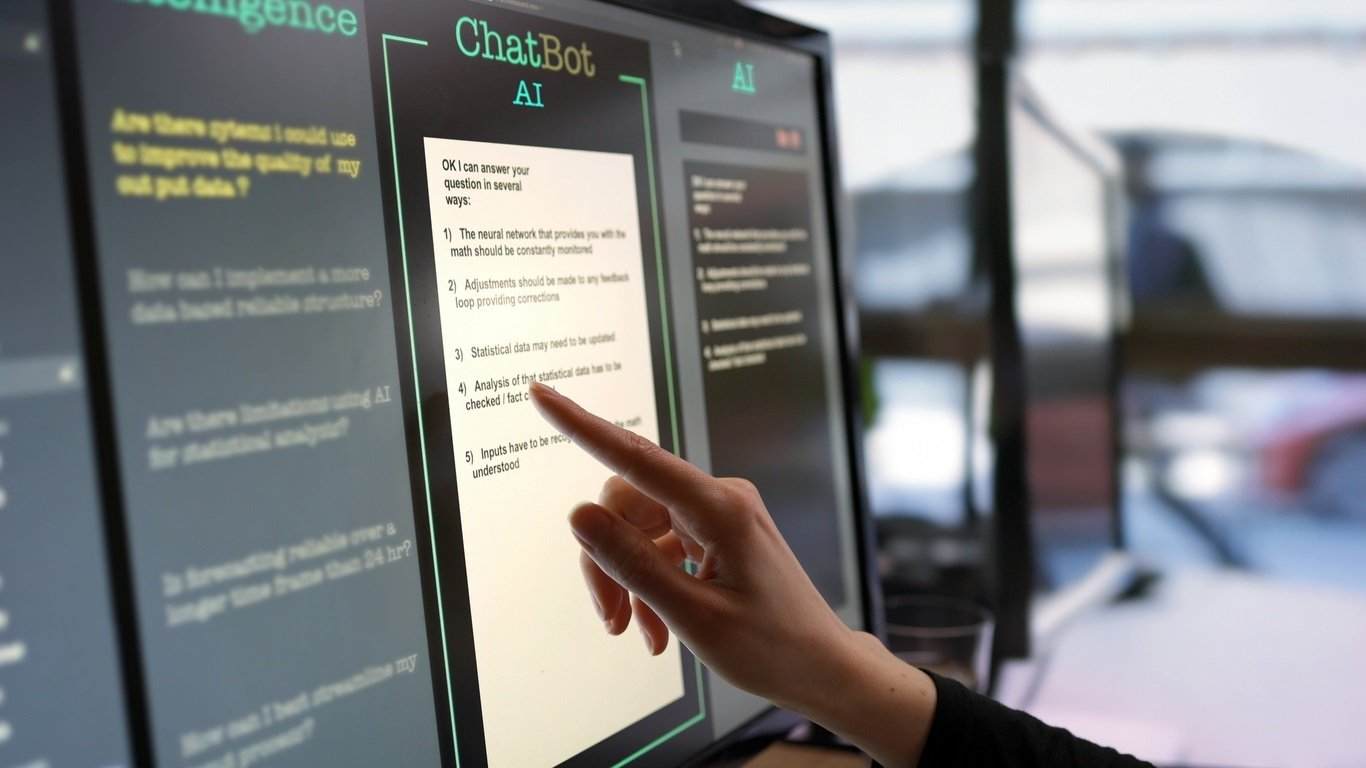

Un primer marco para regular sistemas de IA como ChatGPT

Por ahora se conocen pocos detalles. Por ejemplo, se sabe que se ha construido un primer marco para regular los modelos fundacionales o generativos basados en la inteligencia artificial como ChatGPT o Copilot de Microsoft. Llegar hasta un acuerdo no ha sido sencillo, puesto que la posición de los Estados miembros y la Eurocámara es muy divergente. Los primeros quieren que las empresas se comprometan con un código voluntario de buenas prácticas para garantizar que los modelos fundacionales no suponen un riesgo para las personas y que los datos que se utilizan para entrenar la inteligencia artificial no discriminan, por ejemplo, por razones de sexo, raza o religión. Desde el Parlamento Europeo, en cambio, quieren obligar a las empresas a comprobar que los sistemas son seguros, antes de poder utilizarlos en contextos de riesgo, como la sanidad, la justicia o la contratación laboral.

La IA para la vigilancia en tiempo real a los ciudadanos europeos: un gran punto de fricción

No obstante, este no es el único punto de colisión entre los reguladores europeos: el uso de la IA para la vigilancia biométrica en tiempo real en espacios públicos. Los gobiernos europeos quieren que se pueda utilizar para evitar delitos como el terrorismo, el abuso sexual o la protección de infraestructuras críticas, siempre con la autorización judicial previa.

Hay países de la UE que ya han intentado incorporar esta tecnología a su política de seguridad, entre muchísimas críticas. Es el caso de Francia, donde, de cara a los Juegos Olímpicos de 2024, el gobierno propuso poner en marcha por primera vez cámaras de videovigilancia equipadas con algoritmos de inteligencia artificial, una práctica que los expertos temen que se generalice y acabe siendo un recorte de derechos y libertades permanente.

La Eurocámara, en cambio, se opone a su uso porque considera que la vigilancia biométrica viola los derechos fundamentales, aunque el ponente de la norma en el Parlamento Europeo, el socialdemócrata Brando Benifei, se abrió ayer a permitirla si hay fuertes garantías para proteger los derechos, según informa EFE.